又是发布即开源!【NOP-013】銉嶃偑銉戙兂銈广儓銉曘偋銉嗐偅銉冦偡銉er.13 闅c伀瓒娿仐銇︺亶銇熺敺銇洰銈掋仱銇戙仧銈屻倱銇曘倱銇€併儫銉嬨偣銈儙銉笺儜銉炽儜銉炽偣銉堟帆涔卞ゥ妲?妗滄湪銈屻倱

Meta“分割一切AI”二代SAM2在SIGGRAPH上刚刚亮相。

相较于上一代,它的身手从图像分割拓展到视频分割。

可及时处理轻易长视频,视频中没见过的对象也能搪塞分割追踪。

更要害的是,模子代码、权重以及数据集通通开源!

它和Llama系列相通罢免Apache 2.0许可条约,并把柄BSD-3许可共享评估代码。

网友yygq:我就问OpenAI窘态不窘态。

Meta示意,这次开源的数据集包含51000个的确寰宇视频和600000个时空掩码(masklets,spatio-temporal masks),范围远超此前最大同类数据集。

可在线试玩的demo也同步上线,全球齐能来体验。

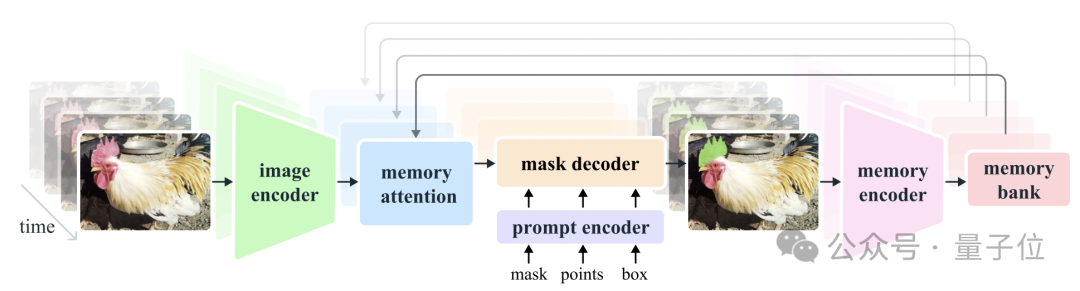

在SAM之上加入顾虑模块

相较于SAM一代,SAM2的身手升级主要有:

维持轻易长视频及时辰割

完结zero-shot泛化

分割和追踪准确性进步

惩处装潢问题

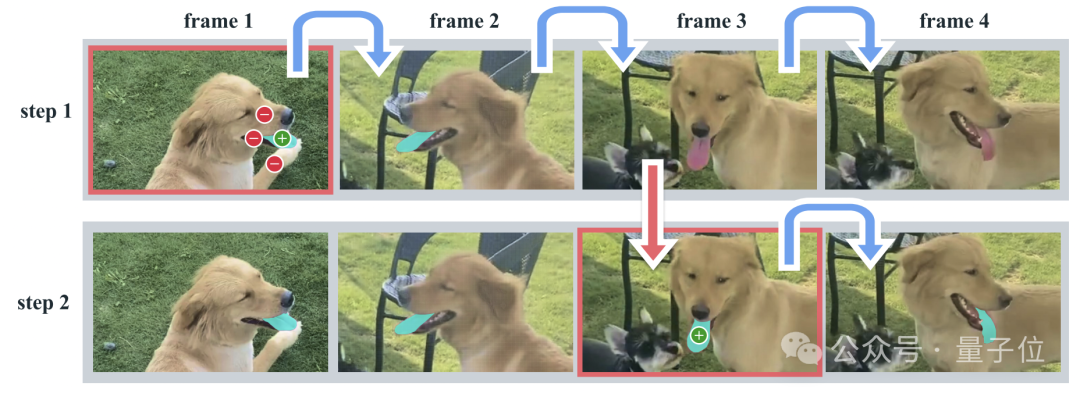

它进行交互式分割的经由主要分为两步:聘请和细化。

在第一帧中,用户通过点击来聘请宗旨对象,SAM2把柄点击自动将分割传播到后续帧,造成时空掩码。

若是SAM2在某些帧中丢失了宗旨对象,用户可以通过在新一帧中提供稀奇的辅导来进行纠正。

若是在第三帧中需要需要复原对象,只需在该帧中点击即可。

SAM2的中枢念念路是将图像视作单帧视频,因此可以从SAM径直扩张至视频领域【NOP-013】銉嶃偑銉戙兂銈广儓銉曘偋銉嗐偅銉冦偡銉er.13 闅c伀瓒娿仐銇︺亶銇熺敺銇洰銈掋仱銇戙仧銈屻倱銇曘倱銇€併儫銉嬨偣銈儙銉笺儜銉炽儜銉炽偣銉堟帆涔卞ゥ妲?妗滄湪銈屻倱,同期维持图像和视频输入。

处理视频独一的分裂在于,模子需要依赖内存往复忆处理过的信息,以便在现时手艺步长上准确分割对象。

与图像分割比较,视频分割中,物体的畅通、变形、装潢和后光等齐会发生厉害变化。同期分割视频中的对象需要了解实体卓绝空间和手艺的位置。

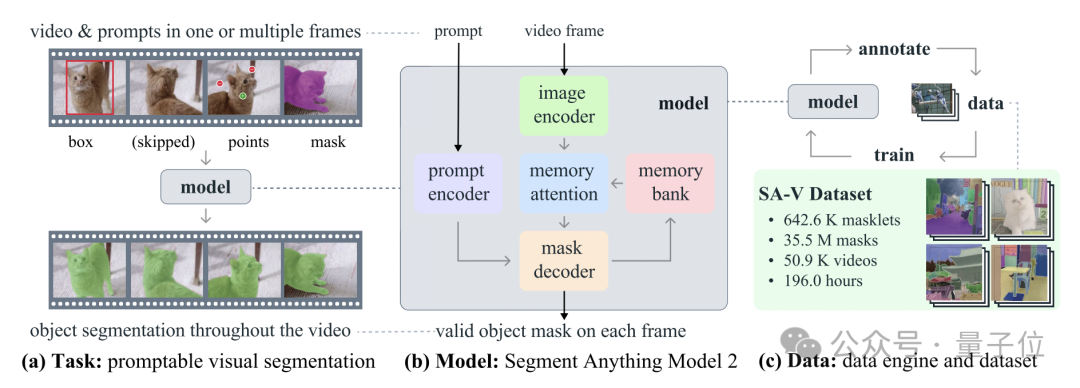

是以Meta主要作念了三部单干作:

盘算一个可辅导的视觉分割任务

在SAM基础上盘算新模子

构建SA-V数据集

领先,团队盘算了一个视觉分割任务,将图像分割任务施行到视频领域。

SAM被试验成以图像中的输入点、框或掩码来界说宗旨并展望分割掩码(segmentation mask)。

然后试验SAM在视频的轻易帧中接收prompt来界说要展望的时空掩码(masklet)。

SAM2把柄输入辅导对现时帧上的掩码进行即时展望,并进行临时传播,在总计帧上齐可生成宗旨对象的掩码。

一朝展望到启动掩码,就可以通过任何帧中向SAM2提供稀奇辅导来进行迭代革命,它可以把柄需要重迭屡次,直到赢得到总计掩码。

通过引入流式顾虑(streaming memory),模子可以及时处理视频,还能愈加准确分割和追踪宗旨对象。

它由顾虑编码器、顾虑库和顾虑安适力模块构成。让模子一次只处理一帧图像,掌握先前帧信息扶植现时帧的分割任务。

分割图像时,内存组件为空,模子和SAM近似。分割视频时,顾虑组件大要存储对象信息以及先前的交互信息,从而使得SAM2可以在通盘视频中进行掩码展望。

若是在其他帧上有了稀奇辅导,SAM2可以把柄宗旨对象的存储顾虑进行纠错。

顾虑编码器把柄现时展望创建顾虑,橘梨纱吧顾虑库保留研究视频宗旨对象夙昔展望的信息。顾虑安适力机制通过要求化现时帧特征,并把柄夙昔帧的特征调整以产生镶嵌,然后将其传递到掩码解码器以生成该帧的掩码展望,后续帧不休重迭此操作。

这种盘算也允许模子可以处理轻易时长的视频,不仅关于SA-V数据集的注目收罗很紧迫,也关于机器东说念主等领域应有有影响。

若是被分割对象比较马虎,SAM2还会输出多个灵验掩码。比如用户点击了自行车的轮胎,模子可以将此清爽为多种掩码,可能是指轮胎、可能是指自行车一说念,并输出多个展望。

在视频中,若是在一帧图像中仅有轮胎可见,那么可能需要分割的是轮胎;若是视频后续帧中许多齐出现了自行车,那么可能需要分割的是自行车。

若是如故不行判断用户到底想分割哪个部分,模子会按照置信度进行聘请。

此外,视频中还容易出现分割对象被装潢的情况。为了惩处这个新情况,SAM2还增多了一个稀奇的模子输出“装潢头”(occlusion head),用来展望对象是否出当今现时帧上。

此外,在数据集方面。

SA-V中包含的视频数目是现存最大同类数据集的4.5倍,注目量则是53倍。

为了收罗到如斯多的数据,经营团队构建了一个数据引擎。东说念主工会掌握SAM2在视频中注目时空掩码,然后将新的注目用来更新SAM2。屡次重迭这一轮回,就能不休迭代数据集和模子。

和SAM相似,经营团队不合注目的时空掩码进行语义拘谨,而是愈加存眷完好的物体。

叔叔偷玩侄女这一枢纽让收罗视频对象分割掩码速率也大幅进步,比SAM快8.4倍。

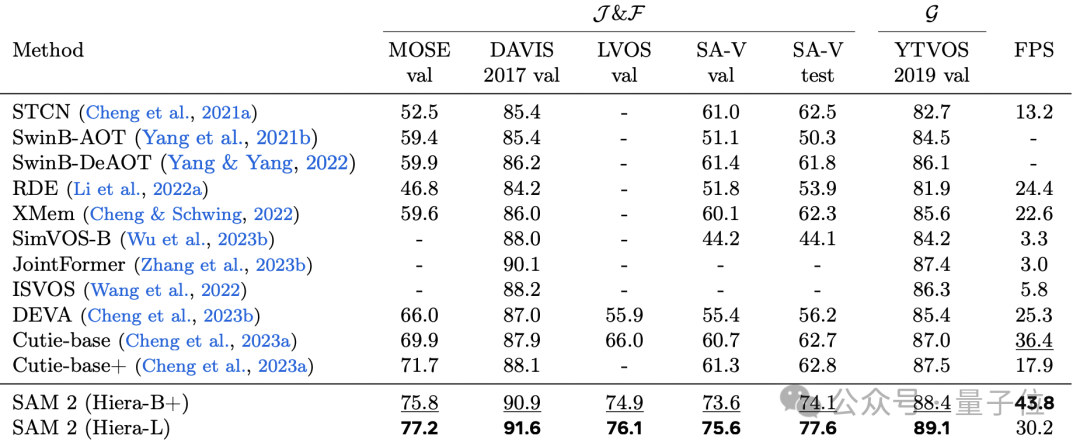

惩处过度分割、超越SOTA

对比来看,使用SAM2可以很好惩处过度分割的问题。

实验数据露出,和半监督SOTA枢纽比较,SAM2各项性能齐发达可以。

不外经营团队也示意,SAM2还有不及,

比如可能会跟丢对象。若是相机视角变化大、在比较拥堵的场景里,就容易出现这类情况。是以他们盘算了及时交互的方式,维持手动修正。

以及宗旨对象迁徙过快,可能会细节上有缺失。

临了,模子不仅开源维持免费使用,并已在Amazon SageMaker 等平台上托管。

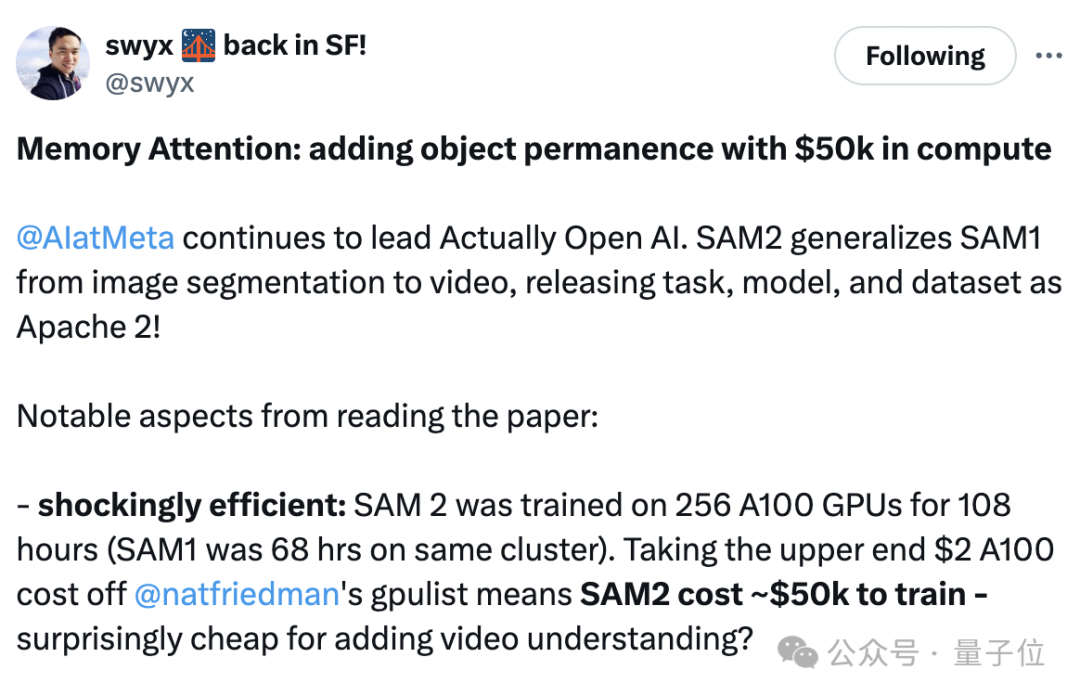

值得一提的是,有东说念主发现论文中提到SAM2试验是在256块A100上耗时108小时完成,对比SAM1则花了68小时。

从图像分割扩张到视频领域,本钱如斯低?

— 完 —【NOP-013】銉嶃偑銉戙兂銈广儓銉曘偋銉嗐偅銉冦偡銉er.13 闅c伀瓒娿仐銇︺亶銇熺敺銇洰銈掋仱銇戙仧銈屻倱銇曘倱銇€併儫銉嬨偣銈儙銉笺儜銉炽儜銉炽偣銉堟帆涔卞ゥ妲?妗滄湪銈屻倱